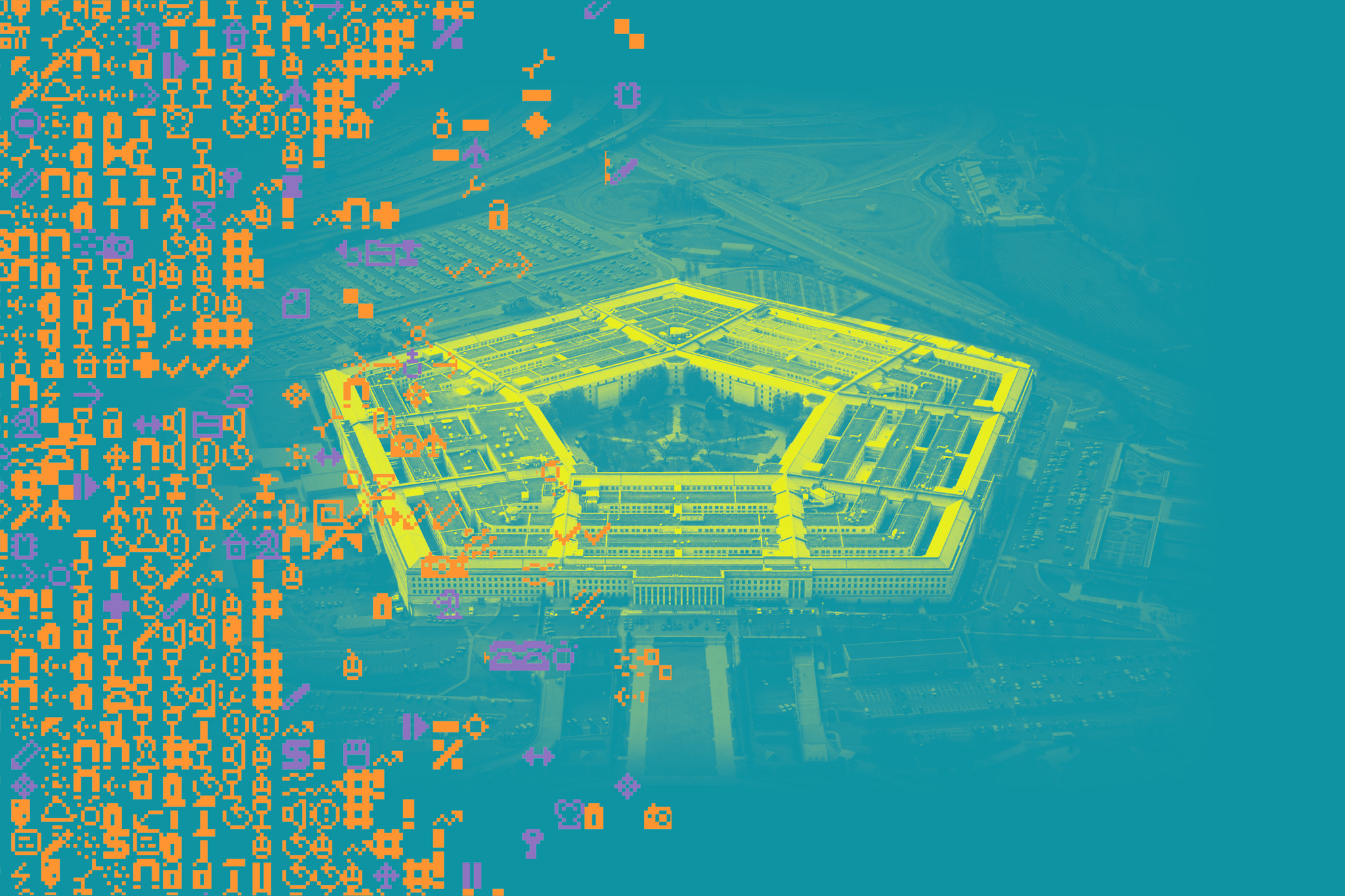

Η πρόσφατη σύγκρουση μεταξύ του αμερικανικού Υπουργείου Άμυνας και της Anthropic είναι το θέμα των ημερών.

Ή μαλλον το πιο σημαντικό θέμα που δεν παίζει στους τίτλους όσο θα έπρεπε.

Και αυτό γιατί παρακολουθούμε μια πρώιμη αλλά ιδιαίτερα αποκαλυπτική στιγμή στη διαμόρφωση της θεσμικής τάξης που θα διέπει τη στρατιωτική χρήση της τεχνητής νοημοσύνης τα επόμενα χρόνια ή ακόμα καλύτερα τις επόμενες δεκαετίες.

Γενικά για χρόνια, η Silicon Valley ήθελε να πιστεύει ότι μπορούσε να αλλάξει τον κόσμο χωρίς να λερώσει τα χέρια της. Να χτίζει ισχυρές τεχνολογίες, να εισπράττει τα κέρδη και όταν προέκυπταν δυσάρεστες χρήσεις, να επικαλείται «αρχές».

Η τεχνητή νοημοσύνη, όμως, έχει αρχίσει να καταστρέφει αυτή την ψευδαίσθηση.

Η πρόσφατη σύγκρουση μεταξύ του αμερικανικού Πενταγώνου και της Anthropic δείχνει γιατί όταν μια τεχνολογία γίνεται στρατηγικά απαραίτητη, η ηθική των κατασκευαστών της μετατρέπεται από εταιρική αρετή σε κρατικό ενοχλητικό εμπόδιο.

Στις 24 Φεβρουαρίου 2026 (γράφω την ημερομηνία για μελλοντικό reference), ο Pete Hesgeth (Υπουργός “Πολέμου” των ΗΠΑ για τον οποίο θα μιλήσω όσο πρέπει κάποια στιγμή) έδωσε τελεσίγραφο στην Anthropic να αποδεχθεί όρους που θα επέτρεπαν τη χρήση του Claude για «όλες τις νόμιμες» στρατιωτικές εφαρμογές.

Ο λόγος είναι ότι η Anthropic δείχνει να επιμένει σε συγκεκριμένες κόκκινες γραμμές, συγκεκριμένα ως προς τη μαζική εσωτερική επιτήρηση και τη χρήση σε αυτόνομα φονικά συστήματα.

Θα μιλήσω και για τα δύο σε λίγο.

Τί εστί Anthropic για αρχή.

Η Anthropic είναι η εταιρεία πίσω από το Claude.

Τί εστί Claude τώρα. Για όσους δεν το χρησιμοποιούν ήδη, το Claude εν τάχει είναι ένα alternative του ChatGPT, του Gemini, του DeepSeek, του Grok και όλων των AI agents, με παρόμοιες εφαρμογές και εύρος.

Η Anthropic τώρα ιδρύθηκε το 2021 από πρώην στελέχη της OpenAI και μέχρι σήμερα έχει συστηματικά προβάλει τον εαυτό της -και θεωρείται γενικά- ως ο πιο safety-minded οργανισμός μεταξύ των κορυφαίων labs.

Αυτός ο αυτοπροσδιορισμός ενισχύθηκε περαιτέρω κατά την περίοδο της κυβέρνησης Μπάιντεν, όταν η εταιρεία συμμετείχε στο ευρύτερο ρεύμα εθελοντικών ελέγχων και αυστηρότερης διακυβέρνησης της ΑΙ.

CEO της εταιρείας τώρα είναι ένας τύπος ονόματι Dario Amodei ο οποίος έχει τόσο καλές σχέσεις με την OpenAI και τον CEO της Sam Altman που στο σχετικό κάλεσμα του Modi να ενώσουν όλοι τα χέρια αυτοί έγιναν πρωτοσέλιδο για το σφίξιμο των χεριών τους.

Anyway. Ο Amodei λοιπόν τον προηγούμενο μήνα δήλωνε:

«Μια ισχυρή τεχνητή νοημοσύνη που θα ανέλυε δισεκατομμύρια συνομιλίες από εκατομμύρια ανθρώπους, θα μπορούσε να αποτιμά το δημόσιο αίσθημα, να εντοπίζει εστίες αναδυόμενης απειθαρχίας ή έλλειψης πίστης και να τις καταπνίγει πριν εξαπλωθούν.»

Καθόλου ανησυχητικό, ξέρω.

Η Anthropic εν προκειμένω δεν είναι μια τυχαία startup που διακηρύσσει αόριστα την υπεύθυνη καινοτομία.

Είναι ένα από τα πιο ισχυρά εργαστήρια ΑΙ στον κόσμο και παράλληλα το πιο επιμελώς προσηλωμένο στη δημόσια εικόνα του ως φρόνιμου ενήλικα του κλάδου. Σε αντίθεση με πιο επιθετικούς αντιπάλους, η εταιρεία γενικά έχει καλλιεργήσει μια ταυτότητα που συνδυάζει frontier τεχνολογία με safety rhetoric.

Αυτό το αφήγημα τώρα λειτουργεί αρκετά καλά μέχρι τη στιγμή που ο χρήστης είναι το αμερικανικό κράτος.

Πάμε λοιπόν.

Η Anthropic συνεργάζεται εδώ και χρόνια με το Πεντάγωνο.

Πιο συγκεκριμένα, η Anthropic ήταν η πρώτη εταιρεία τεχνητής νοημοσύνης που εγκρίθηκε για χρήση σε διαβαθμισμένα στρατιωτικά δίκτυα, με διετή συμφωνία χρηματοδότησης έως τα 200 εκατ. δολαρίων από το αμερικανικό Υπουργείο Άμυνας για υπεύθυνη ανάπτυξη δυνατοτήτων ΑΙ σε αμυντικές επιχειρήσεις. Αυτό σημαίνει ότι το Claude δεν ήταν απλώς διαθέσιμο για θεωρητική χρήση, αλλά είχε ήδη εισέλθει σε περιβάλλοντα αυξημένης στρατηγικής ευαισθησίας.

Αυτό τώρα έχει διπλή σημασία.

Πρώτον, επιβεβαιώνει ότι το κράτος ήδη εξαρτάται, σε κάποιο βαθμό, από ιδιωτικά frontier μοντέλα. Δεύτερον, δείχνει ότι η διαμάχη δεν γίνεται στο στάδιο της θεωρίας, αλλά τη στιγμή ακριβώς που τα συστήματα αυτά περνούν από το εργαστήριο στην πραγματική αρχιτεκτονική ισχύος.

Η Anthropic λοιπόν θέλει να συνεργάζεται με το Πεντάγωνο, αλλά με όρους.

Θέλει τα μοντέλα της να συμβάλλουν σε αποστολές εθνικής ασφάλειας, αλλά όχι να χρησιμοποιούνται για μαζική εσωτερική επιτήρηση ή για εφαρμογές που πλησιάζουν την πλήρως αυτόνομη φονική δράση.

Εδώ ο Amodei εξηγεί αναλυτικά τους λόγους (σε περίπτωση που χρειάζονται επεξήγηση δηλαδή).

Το Πεντάγωνο τώρα, δεν δείχνει ιδιαίτερο ενδιαφέρον για τεχνολογίες που ας πούμε ότι έρχονται με ενσωματωμένη συνείδηση. Η θέση του είναι, στην ουσία, ότι αν μια χρήση είναι νόμιμη και στρατιωτικά χρήσιμη, τότε οι τελικές αποφάσεις ανήκουν στο κράτος, όχι στους μηχανικούς, ούτε στους νομικούς συμβούλους, ούτε στα ηθικά αντανακλαστικά μιας εταιρείας της Silicon Valley.

Αν τώρα η υπόθεση αφορούσε μόνο έναν προμηθευτή, η Anthropic ίσως είχε περιθώριο να επιμείνει.

Όμως το αμερικανικό Υπουργείο Άμυνας έχει ήδη φροντίσει να περιορίσει αυτή τη δυνατότητα. Το περασμένο καλοκαίρι ανακοίνωσε συμβάσεις έως 200 εκατ. δολαρίων για τέσσερις εταιρείες: Anthropic, Google, OpenAI και xAI. Η στρατηγική είναι προφανής. Το κράτος δεν θέλει να εξαρτάται από έναν μόνο πάροχο προηγμένης ΑΙ, ιδίως από έναν πάροχο που πιστεύει ότι μπορεί να του κάνει μάθημα περί ορίων.

Αυτό προφανώς αλλάζει τους όρους του παιχνιδιού.

Και αυτό γιατί η Anthropic μπορεί να υπήρξε η πρώτη εταιρεία ΑΙ που εγκρίθηκε για συνεργασία με το Πεντάγωνο, πράγμα που της έδινε έως τώρα μια σχετική διαπραγματευτική βαρύτητα: δεν ήταν εύκολο να αντικατασταθεί. Αλλά όσο το Πεντάγωνο φέρνει μέσα στο σύστημα και άλλους παίκτες, η μοναδικότητα εξασθενεί.

Και επειδή πάντα σε οτιδήποτε επικίνδυνο, unregulated και εν δυνάμει συγκεντρωτικό βρίσκεται από πίσω ο Elon Musk, η xAI δηλώνει ότι το Grok είναι έτοιμο για ασφαλή χρήση.

Η ενσωμάτωση του Grok αποκτά ιδιαίτερο ενδιαφέρον επειδή ήρθε λίγες μόλις ημέρες αφότου το σύστημα βρέθηκε στο επίκεντρο διεθνούς κριτικής για τη δημιουργία έντονα σεξουαλικοποιημένων deepfake εικόνων χωρίς συναίνεση. Το γεγονός ότι, παρά αυτή τη δημόσια αμφισβήτηση, το Grok εντάσσεται σε αμυντικό περιβάλλον υποδηλώνει ότι το Πεντάγωνο ιεραρχεί σήμερα κυρίως τη συμμόρφωση των παρόχων με το δικό του πλαίσιο, μάλλον παρά τη διατήρηση μιας αυστηρής δημόσιας εικόνας ασφάλειας.

Το συμβόλαιο συγκεκριμένα για το οποίο διαγωνίζεται αυτή τη στιγμή η SpaceX είναι αξίας 100 εκατ. δολαρίων για την παραγωγή voice-controlled λογισμικού για αυτόνομες επιθετικές επιχειρήσεις.

Συνοπτικά αυτό θα δουλεύει ως εξής:

Ο χειριστής του λογισμικού θα δίνει παραδειγματικά τη φωνητική οδηγία: “Neutralize enemy position”, το λογισμικό θα την μεταφράζει επιχειρησιακά και τα drone θα κινούνται αυτόνομα για να την εκτελέσουν, χωρίς επί της ουσίας καμία παρεμβολή ανθρώπινου παράγοντα μεταξύ της αρχικής εντολής και της εκτέλεσης της αποστολής. Εδώ είναι το σχετικό άρθρο του Bloomberg για όποιον ενδιαφέρεται και επειδή είναι πίσω από paywall, εδώ το άρθρο δευτερογενώς.

Συμπληρωματικά τώρα, στο κάδρο μπαίνουν και όλες οι υπόλοιπες ΑΙ εταιρείες. Θυμάστε στο άρθρο για τα data centers του Musk που λέγαμε για την ανάγκη των ΑΙ για ρευστό;

Κάπως έτσι λοιπόν η OpenAI εντάσσεται στο GenAI.mil για μη διαβαθμισμένες εργασίες. Η Google επίσης έχει εγκαταλείψει προ πολλού την παλαιά της αμηχανία. Όσο περισσότερες εναλλακτικές έχει η Ουάσιγκτον, τόσο λιγότερο λόγο έχει να ανεχθεί εταιρικές επιφυλάξεις.

Εδώ βρίσκεται και η ουσία της υπόθεσης: η αγορά της στρατιωτικής ΑΙ διαμορφώνεται έτσι ώστε να τιμωρεί όχι τις λιγότερο ικανές εταιρείες, αλλά τις λιγότερο υπάκουες.

Σε αυτό το πλαίσιο, η σύγκρουση αποκτά και μια πιο καθαρά πολιτική διάσταση εάν εξεταστεί στο πλαίσιο των σχέσεων της Anthropic με την κυβέρνηση Τραμπ.

Η εταιρεία έχει ήδη βρεθεί σε απόσταση από τη διοίκηση σε διάφορα μέτωπα πολιτικής ΑΙ: από τη δημόσια κριτική της προς πιο χαλαρές εξαγωγικές ρυθμίσεις για chips που θα μπορούσαν να διευκολύνουν πωλήσεις προηγμένων επεξεργαστών στην Κίνα, έως τη γενικότερη στήριξή της σε αυστηρότερα ρυθμιστικά πλαίσια για την τεχνητή νοημοσύνη σε πολιτειακό επίπεδο. Δεν είναι τυχαίο ότι πρόσωπα κοντά στην κυβέρνηση έχουν ερμηνεύσει τη στάση της ως απόπειρα «ρυθμιστικής επιρροής» μέσω επίκλησης φόβου.

Με άλλα λόγια, η σημερινή τριβή με το Πεντάγωνο δεν εμφανίζεται ως απομονωμένο γεγονός. Εντάσσεται σε ένα προϋπάρχον μοτίβο δυσπιστίας ανάμεσα σε μια εταιρεία που προκρίνει αυστηρότερους φραγμούς και σε μια κυβέρνηση που θεωρεί τέτοιες παρεμβάσεις εμπόδιο στην τεχνολογική και στρατηγική επιτάχυνση.

Για να το πω φορώντας το καλό μου κοστούμι.

Ο Pete Hegseth, με τη γνωστή του αίσθηση ευθύνης, το διατύπωσε σχεδόν ωμά σε ομιλία στην SpaceX. Δεν θέλει μοντέλα που «δεν θα σε αφήνουν να πολεμήσεις». Η στρατιωτική ΑΙ, κατά τη διατύπωσή του, πρέπει να λειτουργεί χωρίς «ιδεολογικούς περιορισμούς και να μην είναι «woke».

Η φρασεολογία είναι πολιτισμικά φορτισμένη, αλλά η θεσμική της σημασία είναι σαφής. Το Πεντάγωνο δεν αντιλαμβάνεται τα safeguards ως τεχνικά χαρακτηριστικά ή ως διαχείριση ρίσκου. Τα αντιμετωπίζει ως μορφή εξωτερικού ελέγχου πάνω στην κρατική ισχύ.

Αυτό είναι κάτι που καμία σοβαρή κρατική γραφειοκρατία άμυνας δεν πρόκειται να αποδεχθεί εύκολα. Τα κράτη ίσως αγαπούν την καινοτομία. Αγαπούν, όμως, περισσότερο τον έλεγχο.

Η ειρωνεία είναι ότι η τεχνητή νοημοσύνη κάνει αυτό το ζήτημα πιο οξύ απ’ όσο ήταν με προηγούμενες τεχνολογίες. Ένας συμβατικός αμυντικός προμηθευτής παραδίδει συνήθως ένα υλικό ή λογισμικό σύστημα με ορισμένες προδιαγραφές. Ένα μεγάλο γλωσσικό μοντέλο, αντίθετα, έχει φίλτρα, απαγορεύσεις, μηχανισμούς άρνησης, σιωπηρές κρίσεις για το τί θεωρείται επικίνδυνο ή ανεπίτρεπτο. Με άλλα λόγια, η εταιρική ηθική δεν κάθεται απλώς στο συνοδευτικό έγγραφο της σύμβασης. Είναι ενσωματωμένη μέσα στο ίδιο το προϊόν.

Γι’ αυτό και η τωρινή σύγκρουση είναι πιο σημαντική απ’ όσο φαίνεται. Δεν αφορά απλώς αν η Anthropic θα χάσει ή θα κρατήσει ένα συμβόλαιο. Αφορά αν οι δημιουργοί των πιο ισχυρών ψηφιακών συστημάτων της εποχής μπορούν να διατηρούν πραγματικό λόγο για τη χρήση τους όταν απέναντί τους έχουν όχι έναν ιδιώτη πελάτη, αλλά την ισχυρότερη στρατιωτική μηχανή του κόσμου.

Η απάντηση, μέχρι στιγμής, δεν είναι ενθαρρυντική για όσους φαντάζονταν μια ευγενική συνύπαρξη κρατικής ισχύος και εταιρικής αυτοσυγκράτησης.

Η Anthropic έχει επιχειρήσει να βαδίσει σε μια λεπτή γραμμή: να συνεργάζεται με την εθνική ασφάλεια, αλλά χωρίς να απεμπολεί την ηθική της ταυτότητα. Αυτό είναι καλή στρατηγική δημοσίων σχέσεων και πιθανώς ειλικρινής θεσμική επιδίωξη. Είναι όμως και μια δομικά ασταθής θέση. Αν η εταιρεία επιμείνει υπερβολικά, κινδυνεύει να χάσει πρόσβαση και επιρροή τη στιγμή ακριβώς που το Πεντάγωνο οργανώνει τη μαζική ενσωμάτωση της ΑΙ.

Αν υποχωρήσει πλήρως, κινδυνεύει να αποδειχθεί ότι το περίφημο responsible AI δεν ήταν τίποτε περισσότερο από πολυτελές branding, χρήσιμο ώσπου να εμφανιστεί ένας πραγματικός πελάτης με πραγματική εξουσία.

Αυτό είναι το δίλημμα σχεδόν όλων των μεγάλων labs, απλώς η Anthropic το βιώνει πρώτη και πιο εκτεθειμένα.

Η υπόθεση λέει επίσης κάτι ευρύτερο για τη μεταβολή της Silicon Valley.

Η παλιά φαντασίωση ότι οι εταιρείες τεχνολογίας είναι ξεχωριστές από το κράτος, ή και ανώτερες ηθικά από αυτό, ξεθωριάζει γρήγορα. Όταν μια τεχνολογία γίνεται αρκετά σημαντική, το κράτος παύει να τη βλέπει ως απλό προϊόν και αρχίζει να τη βλέπει ως στρατηγική υποδομή. Και οι στρατηγικές υποδομές σπάνια μένουν υπό ουσιαστικό εξωτερικό ηθικό έλεγχο.

Αυτό δεν σημαίνει ότι οι ενστάσεις της Anthropic είναι αβάσιμες. Το αντίθετο.

Η ιδέα ότι μια ισχυρή ΑΙ θα μπορούσε να χρησιμοποιηθεί για ευρείας κλίμακας επιτήρηση, προληπτική ανίχνευση «απειθαρχίας» ή στήριξη υπερ-αυτοματοποιημένων βίαιων εφαρμογών δεν είναι δυστοπική υπερβολή. Eίναι ακριβώς ο λόγος για τον οποίο αυτά τα μοντέλα προκαλούν θεσμική ανησυχία.

Αν κάτι λείπει από τη σημερινή συζήτηση, αυτό δεν είναι περισσότερη τεχνολογική αισιοδοξία. Είναι ισχυρότερη δημοκρατική εποπτεία.

Αλλά εκεί βρίσκεται το επόμενο πρόβλημα. Η νομοθεσία κινείται αργά, οι κυβερνήσεις ακόμη πιο αργά, και η τεχνολογία πολύ γρήγορα. Σε τέτοιες συνθήκες, η πραγματική ρύθμιση δεν γίνεται πρώτα από τους νομοθέτες. Γίνεται από όποιον ελέγχει ήδη το σύστημα: την εκτελεστική εξουσία, τον αμυντικό μηχανισμό και τις εταιρείες που αποφασίζουν αν θα συμμορφωθούν ή αν θα διακινδυνεύσουν τον αποκλεισμό τους. Το αποτέλεσμα είναι προβλέψιμο. Η ισορροπία γέρνει προς εκείνους που ζητούν ταχύτητα, όχι προς εκείνους που ζητούν όρια.

Η ιστορία, λοιπόν, δεν είναι αν η Anthropic θα λυγίσει. Πιθανότατα, σε κάποιο βαθμό, θα το κάνει, όπως συμβαίνει συνήθως όταν το κράτος και η αγορά ευθυγραμμίζονται. Η πιο ενδιαφέρουσα ερώτηση είναι τι θα απομείνει από την ιδέα ότι οι εταιρείες frontier AI μπορούν να λειτουργούν ως αυτόνομοι θεματοφύλακες της υπεύθυνης χρήσης.

Η απάντηση μάλλον είναι: λιγότερο απ’ όσο ελπίζουν οι ίδιες.

Η στρατιωτικοποίηση της ΑΙ δεν θα σταματήσει επειδή ένα εργαστήριο έχει ενδοιασμούς. Το πιθανότερο είναι ότι θα προχωρήσει. Με περισσότερους παρόχους και λιγότερη ανοχή σε όποιον επιμένει να ενσωματώνει ηθικούς φραγμούς σε συστήματα που το κράτος θεωρεί πλέον κρίσιμα. Το ερώτημα, συνεπώς, δεν είναι αν η τεχνητή νοημοσύνη θα γίνει μέρος της πολεμικής μηχανής. Ήδη γίνεται.

Το ερώτημα είναι αν οι δημοκρατίες θα προλάβουν να ορίσουν αξιόπιστους κανόνες λογοδοσίας πριν η επιχειρησιακή λογική καταστήσει αυτούς τους κανόνες διακοσμητικούς.

Η ιστορία είναι γεμάτη από σκάνδαλα εταιρικής διακυβέρνησης όταν οι ρυθμιστικοί κανόνες εξασθενούν, ή εφαρμόζονται κατά το δοκούν.

Και ας πούμε ότι αυτή την εποχή η χαλάρωση κάθε είδους αρχών δεν αποτελεί καν θέμα συζήτησης. Έχει γίνει η νόρμα.

Το ΑΙ δεν θα μπορούσε να λείπει από αυτό.

Ή για να το πω διαφορετικά, το Skynet απέχει ακόμα μερικά χρόνια από το να γίνει πραγματικότητα. Αυτή την εποχή ωστόσο παρακολουθούμε την δημιουργία του.

Χρήσιμοι σύνδεσμοι:

https://www.reuters.com/world/anthropic-digs-heels-dispute-with-pentagon-source-says-2026-02-24/

https://www.theguardian.com/us-news/2026/feb/24/anthropic-claude-military-ai

https://www.axios.com/2026/02/24/anthropic-pentagon-claude-hegseth-dario